引言:AMD芯片的破局之路

在半导体行业进入后摩尔定律时代,AMD凭借其独特的“Zen”架构和Chiplet(小芯片)设计理念,成功打破了传统芯片设计的性能与成本桎梏。从服务器到消费级市场,AMD通过持续的技术迭代和生态协同,正在重新定义高性能计算的标准。本文将从架构创新、制程工艺、生态布局三个维度,解析AMD芯片的技术突破路径。

一、Zen架构:从“追赶者”到“领跑者”的跨越

AMD的Zen架构是其技术复兴的核心引擎。自2017年首代Zen发布以来,AMD通过以下关键技术实现了性能与能效的双重跃升:

- 模块化设计:Zen架构采用模块化CCX(CPU Complex)设计,通过灵活组合核心数量,满足从桌面到服务器的多样化需求。例如,第三代EPYC处理器通过集成多达64个Zen 3核心,在SPECint基准测试中创下行业纪录。

- 同步多线程(SMT)优化:Zen架构的SMT技术通过动态分配线程资源,使单核心性能提升高达40%,尤其在多任务处理场景中表现显著。

- Infinity Fabric互联技术:AMD独创的片间互联方案,将CPU、GPU和I/O模块通过高速总线连接,实现低延迟数据传输。这一技术为后续的Chiplet设计奠定了基础。

案例:Zen 4架构的能效革命

2022年发布的Zen 4架构进一步突破物理极限:采用5nm制程工艺,IPC(每时钟周期指令数)提升13%,同时引入AVX-512指令集和AI加速单元。在相同功耗下,Zen 4的每瓦性能较前代提升35%,成为数据中心节能降耗的标杆方案。

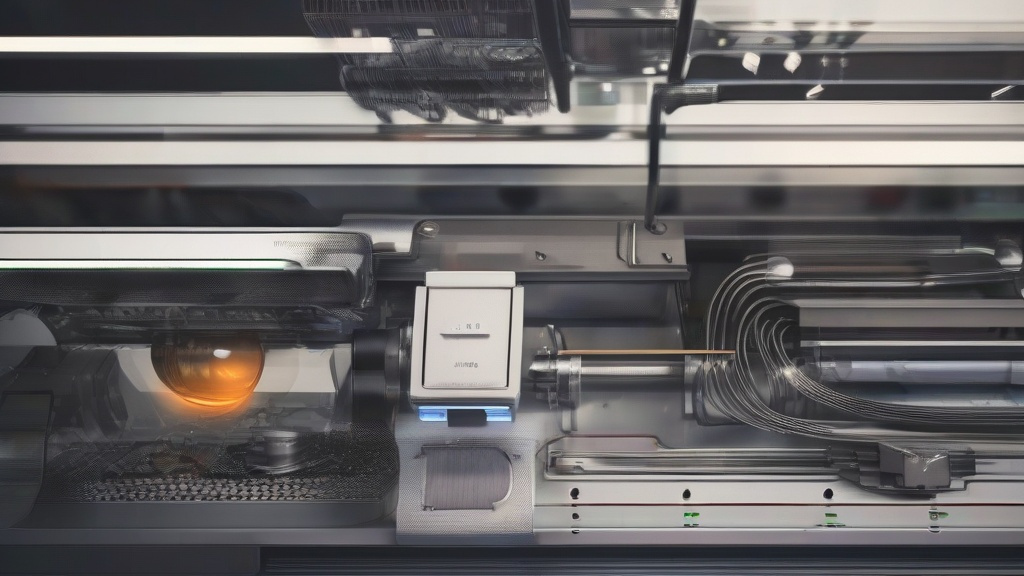

二、Chiplet战略:重构芯片制造的经济学

面对先进制程成本飙升的挑战,AMD率先将Chiplet技术商业化,通过“分而治之”的策略降低研发风险与生产成本:

- 成本优化:将大尺寸芯片拆分为多个小芯片,可显著提升良率。例如,EPYC处理器通过组合多个7nm Chiplet,相比单芯片设计成本降低40%。

- 异构集成 :Chiplet允许混合使用不同制程的模块(如CPU核心采用5nm,I/O模块采用12nm),实现性能与成本的平衡。

- 生态扩展性 :标准化Chiplet接口(如AMD的UCIe兼容方案)为第三方IP集成铺平道路,未来可能催生“芯片乐高”式的定制化解决方案。

行业影响:推动半导体供应链变革

AMD的Chiplet战略已引发行业共振。台积电、英特尔等厂商纷纷布局先进封装技术,而UCIe联盟的成立更标志着Chiplet生态进入标准化阶段。据Omdia预测,到2027年,Chiplet市场规模将突破500亿美元,AMD有望占据30%以上份额。

三、生态协同:从硬件到软件的全面赋能

AMD的技术突破不仅限于芯片本身,更通过软硬协同构建了覆盖全场景的生态体系:

- ROCm开源平台:针对AI和高性能计算(HPC)场景,AMD提供与CUDA兼容的开源软件栈,吸引谷歌、特斯拉等企业加入生态。

- Smart Access Memory(SAM)技术:通过PCIe 4.0总线实现CPU对GPU显存的直接访问,在游戏中提升平均帧率10%以上。

- 云原生优化:与AWS、微软Azure等云服务商合作,针对虚拟化场景优化EPYC处理器的核心调度算法,使单服务器虚拟机密度提升50%。

未来展望:AI与异构计算的融合

随着AMD收购Xilinx,其技术路线图进一步向AI加速领域延伸。下一代“Zen 5”架构将集成CDNA 3 GPU核心和Xilinx FPGA可编程逻辑,形成“CPU+GPU+FPGA”的异构计算平台。这一布局有望在自动驾驶、科学计算等领域开辟新增长点。

结语:AMD的启示与行业意义

AMD的崛起证明,在半导体行业,技术路线选择与生态布局同样重要。通过Zen架构的持续迭代、Chiplet的成本革命和生态系统的开放协作,AMD不仅重塑了自身竞争力,更为行业提供了“后摩尔时代”的创新范本。未来,随着3D封装、光互连等技术的成熟,AMD有望在万亿级半导体市场中扮演更关键的角色。